Alle Inhalte erstellt von Wyndor

-

KI Musik für Midgard

Das ist dir schon sehr gut gelungen. Schöne Idee, hat mich sehr zum schmunzeln und Fusswippen gebracht 😄

-

Perry Rhodan Schwampf - Diskussionen über Perry Rhodan

Hier sind doch bestimmt viele Rhodan Experten unterwegs. Ich habe von Rodan bisher nur ein paar abgeschlossene Kurzserien gelesen und einige Hefte ab Band 2.500. habt ihr eine Empfehlung, bei welchem Zyklus ich nochmal ansetzen kann, um für die Abenteuer des Rollenspiels gut informiert zu sein? Dabei ist mir wurscht, ob ich bei Heft 800 anfange oder später einsteige. Vielleicht habt ihr ja auch Empfehlungen für bestimmte abgeschlossene Kurzserien oder Bücher.

-

Perry Rhodan Schwampf - Diskussionen über Perry Rhodan

Ja, eBay. Habe mal wieder an Rhodan gedacht nachdem wir Riss in der Zeit gespielt haben und da war gerade eine passende Auktion.

-

Perry Rhodan Schwampf - Diskussionen über Perry Rhodan

Ach ich freu mich. Hab die Woche in der Bucht das OVP Grundregelwerk, OVP Sie Basis, vier Abenteuer und Demetria für 65 Euronen geschossen. Jetzt muss ich nur noch Spieler finden 😄

-

Myrkgard - PDF

Klasse!

-

KI Videogenerationen (Veo, Kling, Midjourney etc.)

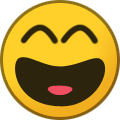

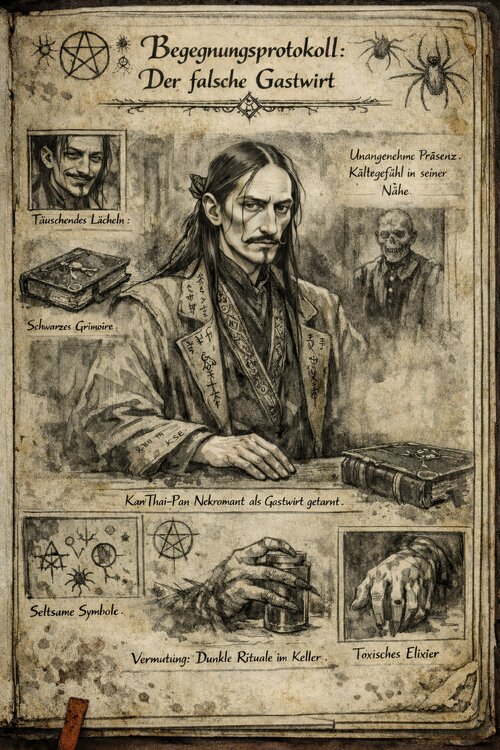

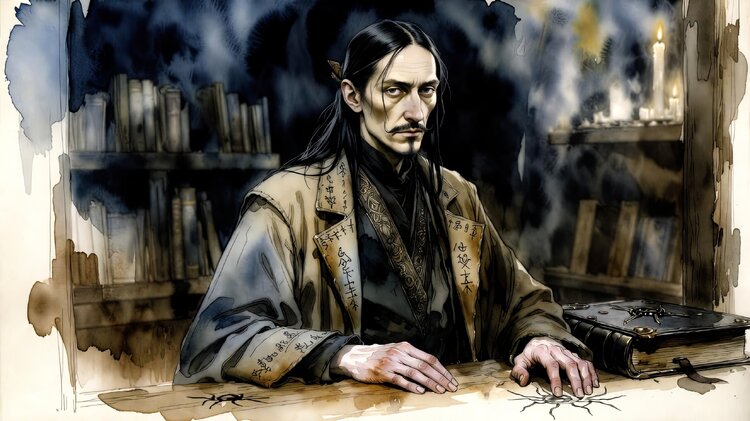

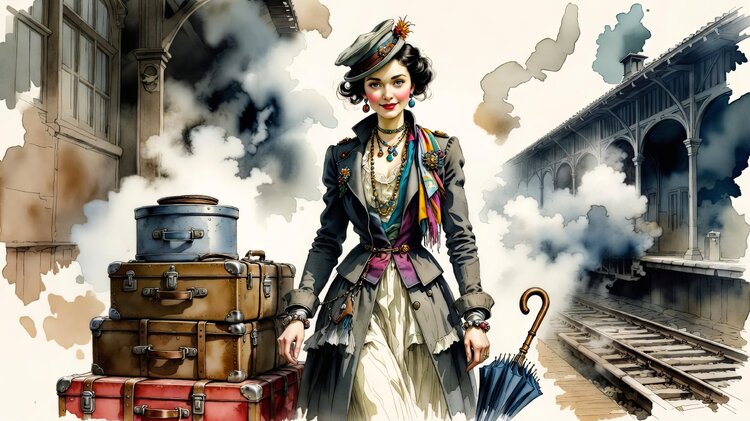

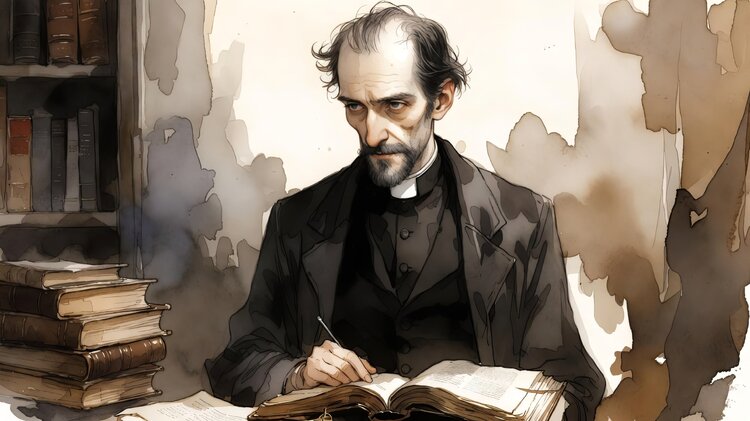

Schaut mal, in so eine Richtung könnte die Bebilderung gehen. Wie findet ihr das? Für heute Abend ist es mir zu grausam, weil auch Kinder mitspielen, aber für eine Erwachsenen-Runde kann ich mir den Shift in etwas mehr Horror ganz gut vorstellen. Das ist dann eine schöne Grundlage für den 1880er Part.

-

KI Videogenerationen (Veo, Kling, Midjourney etc.)

Ja, ich versuche Abenteuer 1880 bei uns als Backup Runde zu etablieren, wenn die Besetzung der Fantasy Runde nicht vollzählig ist. Vielleicht mache ich noch ein paar Illustrationen der Begegnung und wenn mich die Muse küsst ein kurzes Video dazu 😄

-

KI Videogenerationen (Veo, Kling, Midjourney etc.)

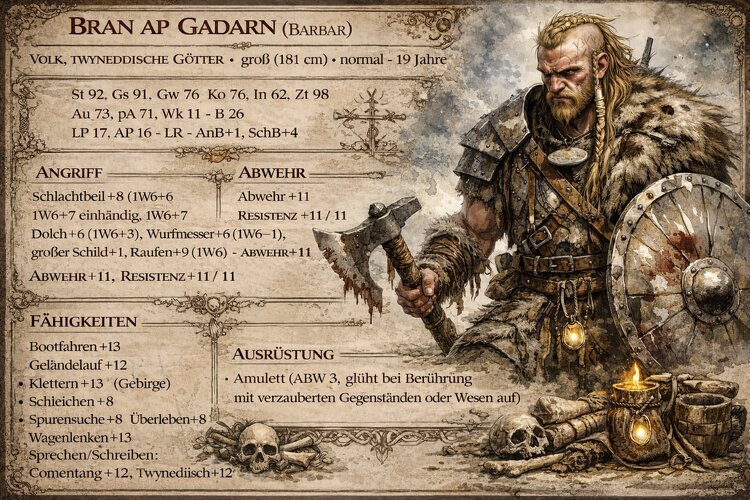

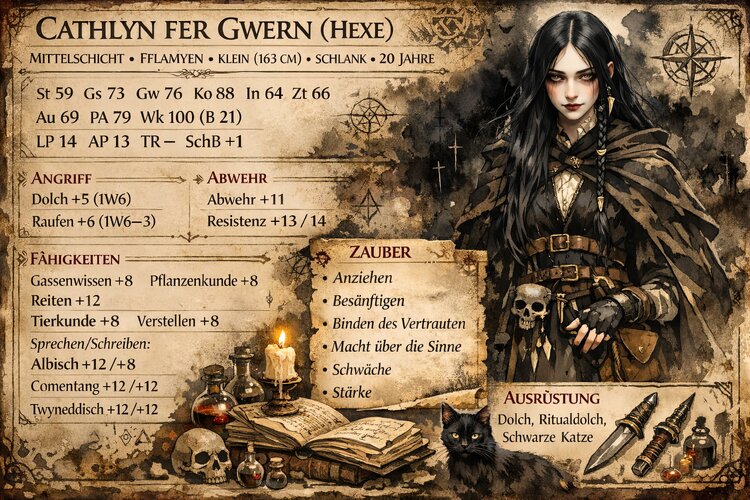

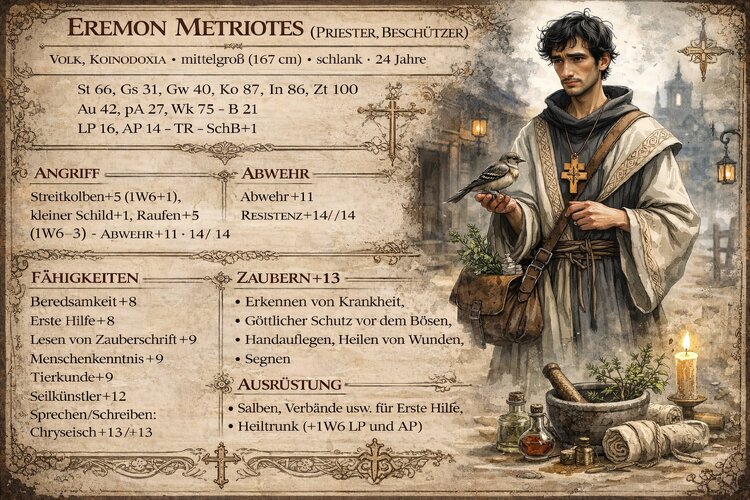

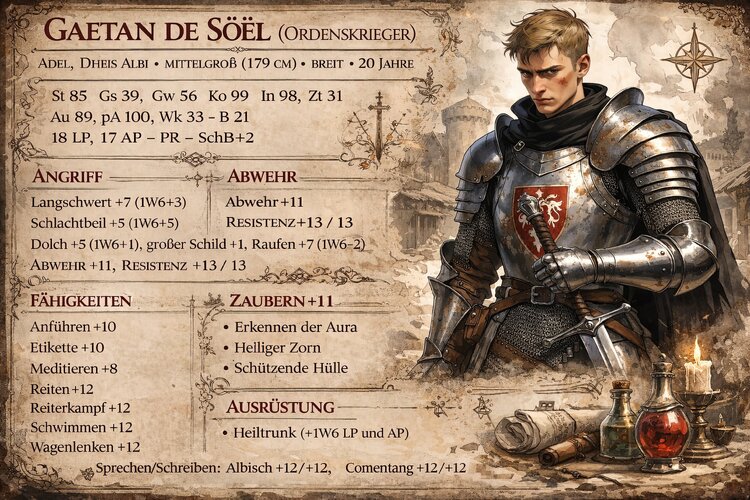

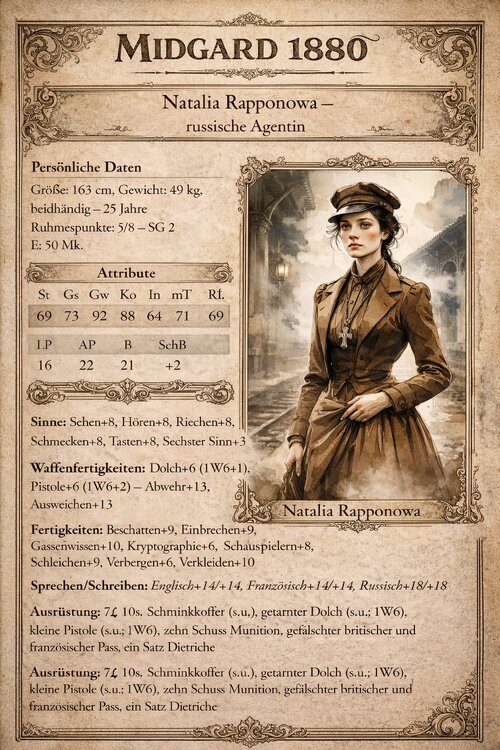

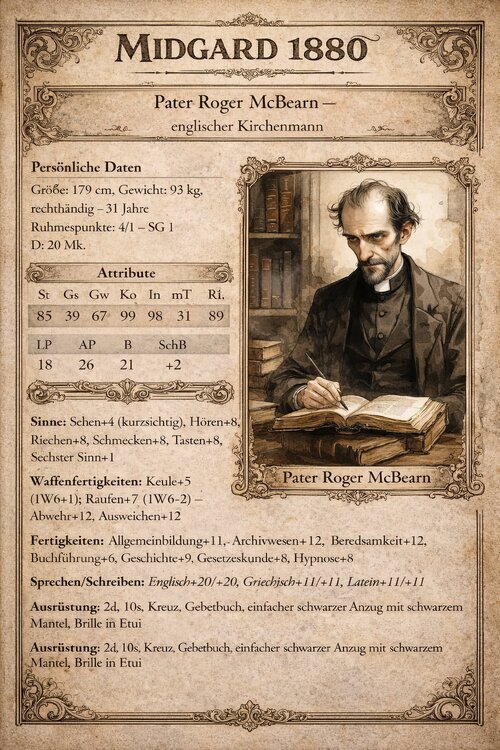

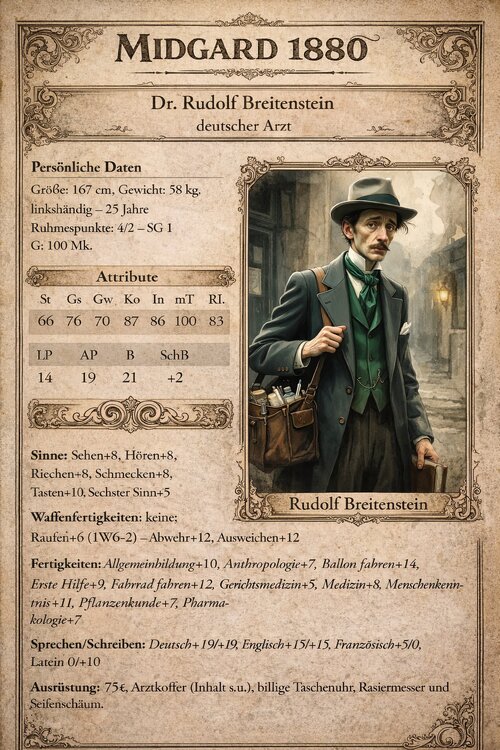

Ist ein neuer Workflow, weil vieles davon bisher nicht ging. 1) Entwicklung eines Bildstil-Promptes in ChatGPT Das war dann der hier: twyneddin exile witch from ywerddon, late twenties, slender but resilient figure with pale sharp features and an intense calculating gaze, long dark raven hair partly loose and partly braided with small bone charms and threads, dark tired eyes marked by loss and exile, wearing worn noble garments adapted for travel, layered dark cloak and weathered leather pieces, subtle remnants of aristocratic embroidery visible on sleeves, fingers stained with ink and faint traces of ritual chalk, holding a small leather spellbook and a pouch of charms, a sleek black cat with intelligent eyes sitting calmly at her feet, posture controlled and observant, hint of restrained bitterness and hidden power, standing in the shadowy alley near a rough frontier tavern, faint occult symbols scratched into stone nearby, gritty low fantasy atmosphere with subtle supernatural horror undertones, watercolor fantasy illustration, loose painterly brushwork, cold desaturated colors with dark muted tones, misty textures, traditional fantasy book illustration style Weitere Motive habe ich dann beschrieben und ChatGPT den Prompt dann an diesen Bildstil anpassen lassen. 2) Generierung der Portrait Bilder mit Flux Flux hat für mich den Prompt am besten umgesetzt, also hat am meisten meinen geschmack getroffen. 3) Portrait-Bilder in ChatGPT weiter bearbeitet 3a) Erstellung von Gruppenbildern durch Upload der fünf Einzelportraits 3b) Erstellung von Charakterbögen durch Bereitstellung des Portraits und der Stats In einem Chat dann darauf verweisen, dass der nächste Charakterbogen dem vorherigen entsprechen soll. Die Stilinterpretation, was zu Midgard 1880 passt und was zu Midgard Fantasy, das hat ChatGPT ganz alleine gemacht.

-

KI Videogenerationen (Veo, Kling, Midjourney etc.)

Danke dir! Ich finde es total krass, mit wie wenig Aufwand sich heute solche stilistisch konsistenten Konzepte umsetzen lassen, mittlerweile auch mit Text. Vor 6 Monaten war das noch nicht möglich. Ich bin gespannt, was morgen alles so geht.

- KI Videogenerationen (Veo, Kling, Midjourney etc.)

-

[Umfrage] Weitere Abenteuer auf Damatu

Danke für die Umfrage. Was für mich am reizvollsten wäre, ist ein Kontrast zum Archipel der Winde, eine Region die euer Konzept von den unterschiedlichen Erzählräumen erfahrbar werden lässt. Meine persönlichen Leidenschaften gehen dann Richtung klassische Dungeon Crawler oder Horror Szenarien. Es sollte nur nicht "mehr vom Gleichen" sein. Ich bin gespannt!

-

KI Videogenerationen (Veo, Kling, Midjourney etc.)

So, auch die kurze Erzählung "Im Zwielicht. Eine Schauergeschichte aus dem Wald ohne Wiederkehr" (Das Schwarze Auge) habe ich wieder eingestellt: https://youtu.be/-GP0VFyxYW8

-

KI Videogenerationen (Veo, Kling, Midjourney etc.)

So, ich habe auch eines meiner ersten Übungsvideos wiederhergestellt. Man sieht dem Clip das Alter von einem 3/4 Jahr an, aber ich finde es immer noch ganz nett. Ist in diesem Fall aber mal zur Abwechslung kein Fantasy sondern ein Abgesang auf die Menschheit, natürlich gesungen von einer KI. https://youtu.be/kbbrL1Y1aiw?is=Kb2TE-v2hg_XaNZ8

-

KI Videogenerationen (Veo, Kling, Midjourney etc.)

Nichts neues, nur zur Info, dass ich die Clips zu Ras Tabor aus dem DSA1 Abenteuer "Durch das Tor der Welten" und meinen Musikclip "Defender - Across the Orkland" mit der Musik von Manowar wieder hergestellt habe: Defender - Across the Orkland: https://youtu.be/ReA5w7hlSmM?si=o03iW_uzSPnAFVSd Willkommen auf Ras Tabor: https://youtube.com/shorts/y9ZUXntg7Ro?si=QyYjkpTib7XwOSE_

-

Teaser Video für meine Midgard - Legenden von Damatu Runde

Das kann ich gar nicht so genau abschätzen. Ich grübel tagsüber über Szenen und Musik nach, prompte zwischendurch Versuche, sammel, was mir gefällt und setze mich dann irgendwann an die Schneidearbeit und schaue, ob schon alles zusammenpasst. Ich schätze mal, das lief so über eine Wochen, plus dann ein paar Stunden Arbeit an der Musik und beim Videoschnitt mit Feedbackschleifen. Insgesamt vielleicht so Pi mal Daumen 12 Stunden Arbeitszeit. Aber es freut mich sehr, dass der Clip dir gefallen hat 😃.

-

Teaser Video für meine Midgard - Legenden von Damatu Runde

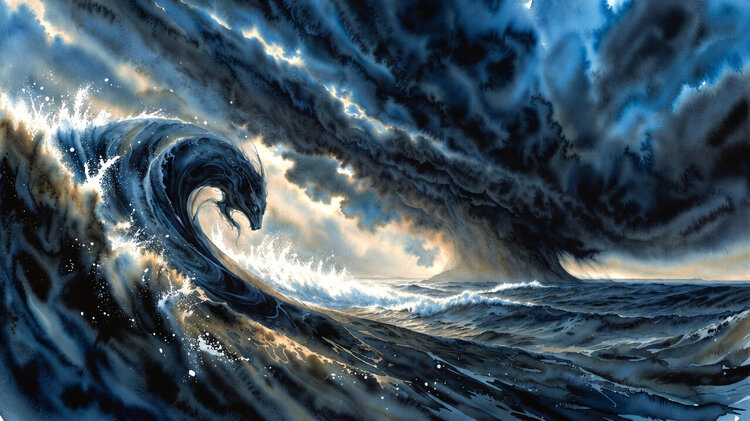

Auf zur letzten Runde @KoschKosch . Ich hoffe, ich habe dann deine Frage umfänglich beantwortet 😄. Ein Pirate der Piratenrepublik Daidar. Ich denke, die Inspiration ist klar. Ich freue mich riesig auf einen Regionalband dazu. Eine Kriegerin aus Hulda. Die hatte ich im Entwurf auch mit Kettenhemd-Bikini (ja, ich bin auch ein Red Sonja Fan), aber das war mir dann doch zu plump. Und nach dem Kommentar von @Jürgen Buschmeier habe ich mich dann wohl in seinem Sinne auch richtig entschieden. Eine seltsame Pflanze. Dies war eigentlich eine Auftaktsequenz für eine kurze Serie, die angelehnt ist an den Hintergrund des Abenteuers "Die Umstürmten". Eine seltsame kleine Pflanze ist in wirklichkeit die Essenz einer Kreatur aus der Chaosebene. Diese wächst zu einem quallenartigen Wesen heran, dass die Barriere zur Chaosebene durchbricht und Wesen von dort nach Damatu vordringen, wie der abschließende Chaoswal. Aber ich habe mich dann für eine andere Zwischensequenz entschieden, weil mir das visuell zu langweilig war. Das erläutere ich gleich. Ein Marid-Wächter. In Al-Qadim gibt es eine Stadt, deren schroffe Küste von Marid bewacht wird. Diese führen die Schiffe quasi an der Leine durch das Riff-durchzogenen Meer in den sicheren Hafen, aber eben nur jene Schiffe, die willkommen sind. Diese Einbindung von Elementarwesen in das Leben fand ich schon immer total ansprechend und Damatu gibt mir die Möglichkeit, diese tollen Facetten aus Al-Qadim stimmig zu integrieren. In diesem Fall ist das Schiff nicht wirklich willkommen. a) Die Qualle, die es am Ende nicht in das Video geschafft hat. Der Chaoswal. Erklärt habe ich ihn oben unter 27. Er ist durch einen Riss zur Chaosebene nach Damatu vorgedrungen. Mein Abschluss für das Video. Ich denke der muss nicht erläutert werden. Noch unkommentiert ist die Musik. Hier wollte ich durch Flöte mit Streichern zusammen eine fließende Musik haben, die zum einen den "fließenden Charakter" der Welt (so fühlt es sich für mich an) zum Ausdruck bringt, durch die Flöte aber noch einen leicht exotischen touch bekommt. Das ganze sollte dann mit gut platzierten Trommeln die für einen Trailer notwendige Wucht verliehen bekommen. Ich habe einige Anläufe mit Suno gebraucht, bis ich das Ergebnis erzielt habe und musste dann nochmal mit Audioschnitt rangehen, aber ich war dann sehr zufrieden. Ich hoffe, die Musik unterstützt das Gefühl der Bilder/Animationen gut, so dass ein stimmiges Gesamtkonzept entsteht, wie sich Damatu für mich anfühlt.

-

Teaser Video für meine Midgard - Legenden von Damatu Runde

Danke dir, das freut mich sehr 😀

-

Teaser Video für meine Midgard - Legenden von Damatu Runde

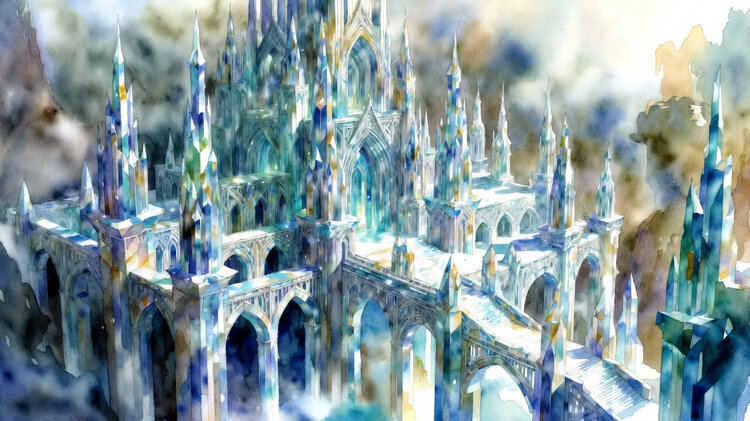

Ein Zyklop. Ich mag Zyklopen. Aber für Damatu habe ich ihn mir zivilisierter gewünscht, als den Menschenfressenden Einsiedler auf der Insel. Die KIs 2025 hatten Probleme damit. Die bekommen jetzt sogar einen Ettin hin! Leider hat die Animation aus einem Ettin immer zwei Riesen gemacht. Aber wie der Zyklop so dahin schlendert, fand ich den einfach nur zu gut. Für mich einfach nur ein schönes Lebewesen, das die Welt Damatu bereichern kann. Kult des Blutmondes. Hier greife ich wieder den Aspekt der bösen Kulte aus dem Point-of-Light-Setting von D&D4 auf, das so schön zu den LvD passt. Diesmal nicht in Form eines schrecklichen Scheusals, sondern in einem Kult, der die Frauen des Umlandes bindet, verzaubert und ihren Glauben korrumpiert. Auf Damatu habe ich diesen Kult in den Wilden Dunkelfeldern angesiedet. Eine Silberelfe des Reiches Symeldin. Zauber der Geistervögel. An der Küste von Lun sind diese wundersamen Vögelschwärme zu sehen, wenn sich ein Unheil zusammenbraut. Wunderschön und dennoch ein schlimmes Omen. Die Inspiration kommt aus den Geschichten aus Lun, in der Magie in unterschiedlichen Formen omnipräsent ist. Die dunkle Vision. Keine Kreatur, sondern eine dunkle Vision, die in die Träume der Bewohner von Lun eindringt. Es ist die drohende unbekannte Gefahr und für meine Runde ein wunderbarer Stimmungsmacher für Abenteuer, in denen die Grenzen zur nahen Chaoswelt durchbrochen werden. Die Inspiration kommt natürlich aus den Geschichten aus Lun. Kristallpalast - natürlich angeregt durch das Abenteuer "Ein Himmel aus Glas" Wassergeist. Wo die Übergänge zu anderen Ebenen wie auch der Wasserebene so durchlässig sind, muss es auch einen Wassergeist geben. Dieser hier ist visuell inspiriert aus dem Film "Spirited Away". Neshu im Kampf. Aus meinen Versuchen, die Neshu visuell mit KI zu beschreiben ist auch dieses Video entstanden. Konzeptionell dem anderen sehr nahe, weil aus dem gleichen Prompt entstanden, aber die Neshu nochmal mit einer ganz eigenen Dynamik umgesetzt, die ich gerne mitnehmen wollte.

-

Teaser Video für meine Midgard - Legenden von Damatu Runde

Es ist nicht fraglicher, als der Einsatz von KI generell. Und da kann man sich jetzt wunderbar in die Wolle kriegen. (Ich meine im Tanelorn Forum explodieren diese Diskussionen regelmäßig in wüste Beschimpfungen). Ich würde darum bitten, das nicht in diesem Faden zu machen, sondern bei Diskussionsbedarf dazu einen anderen Faden zu verwenden. Ich nutze als Prompt für den Stil ein generisches "aquarell fantasy illustration". Die Ergebnisse siehst du oben. Für mich ist das Aufgreifen und das Video ein Verneigen vor den Entwicklern der Welt und des Artworks.

-

Teaser Video für meine Midgard - Legenden von Damatu Runde

Danke dir. Es freut mich, wenn es dir gefällt. Der Aquarell-Stil ist ja vom offiziellen Artwork abgekupfert. Das war mir wichtig. Ich hoffe, damit den Künstlern nicht auf die Füße zu treten, weil ich das Design der LvD wirklich super gelungen finde. Ich finde es auch gut und richtig, dass Pegasus eine "Keine KI" Policy fährt. Da habe ich beim alten Verlag eher mal ein Auge zugedrückt. Die Bildkonsistenz hat in diesem Video weniger mit meinen Skills als mit dem aktuellen Stand der Technik zu tun. Letztes Jahr musste ich noch Bild Sets programmieren und mit ChatGPT Prompt-Muster entwickeln, um einen einheitlichen Stil zu bekommen. Heute beschreibt man nur noch. Je weniger Worte, die präzise treffen, um so besser wird das Ergebnis. Hier bleibt jetzt aktuell noch ein latentes Abdriften in einen Manga/Anime Stil (dem man durch Selektion entgegen wirken kann) und manchmal wir im Prozess der Animation der Stil verändert, aber ich gehe davon aus, dass sich solche Themen in wenigen Monaten auch erledigt haben.

-

Teaser Video für meine Midgard - Legenden von Damatu Runde

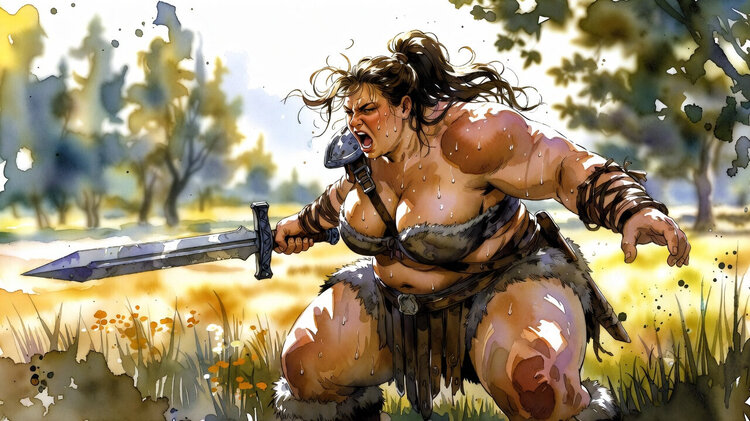

Heilerin wirkt einen Heilzauber auf einen Offizier Eine Botin reitet durch den Myrskogur (dumme Idee) Ein Barbar aus Azarlar (ja, ich mag Barbaren. Habe ich schon erwähnt, dass Conan mein Lieblingsfilm ist? Kommt noch eine 😅) Eine Gnomin, Schlitzohr. Inspiriert durch Harune Labana aus "Die Umstürmten" Eine elfische Dunkelhexe aus Osuria. Neben Anlehnungen zu Al-Quadim (kommt noch mehr) finde ich in Damatu viele Elemente wieder, die das Setting von D&D4 geprägt haben. Das war ein komplett neues "Points-of-light" Setting, eine Welt in Trümmern mit unzähligen finsteren Gestalten und dämonischen Kulten. Dazu werde ich in meinem Setting ähnliche Bezugspunkte machen. Die elfische Dunkelhexe hier hat sich in Osuria niedergelassen und schart Monster wie Trolle und Kobolde um sich, die sie mit ihrer Magie kontrolliert. Eine Neshu im Kampf mit einem monströsen Erdwurm. Mit den Neshu habe ich mich schwer getan, weil es von meiner geliebten "klassischen Fantasy" abweicht. Die KI Bildgeneratoren tuns sich damit übrigens auch schwer. Ich habe versucht unterschiedliche Konzepte zu entwickeln, wie eine Neshu wirkt und kämpft. Das hatte mir ganz gut gefallen. Die dritte Barbarin aus Azarlar. Ich fand das Bild einfach stark und wollte sie unbedingt dabei haben. Ich finde, sie hat unglaublich viel Power. Warum ständig Azarlar? Das ist für mich das "gritty" low-fantasy Gegenstück zum Archipel der Winde. Und diesen Spannungsbogen der Welt Damatu möchte ich in meinem Setting durchziehen. Also nicht nur diese unterschiedlichen Ausprägungen der Welt, sondern auch das Besondere der Grenzüberschreitungen und überraschenden Begegnungen. Eine Neshu Spionin. Das ist tatsächlich die Darstellung eines Charakters aus meiner Runde. Die Spielerin wollte ein "Katzenwesen, das heimlich/diebisch ist und auch zaubern kann". Antwort: Kein Problem 😄

-

Teaser Video für meine Midgard - Legenden von Damatu Runde

Danke für das Feedback . Das freut mich.

-

Teaser Video für meine Midgard - Legenden von Damatu Runde

Oh, das mache ich gerne. Allerdings ist das etwas aufwendiger, daher lass es mich in Etappen zerlegen. Ich gehe einfach mit Hilfe der Basisbilder die Sequenzen durch. Am Anfang bilde ich vor allem unterschiedliche Heldentypen ab. Hier mal die ersten acht Sequenzen. Ein Magier aus Lun, der einen Erkenntniszauber wirkt. Ein junger Akolyth, der die Wunder der Welt bestaunt. Hier kommt der höhere Einfluss der Chaosebene zum Vorschein, der in manchen Regionen Damatus das Magielevel erhöht, und das nicht nur durch mehr Magie in der Luft, sondern durch magisch durchzogene Pflanzen (hier) und Tiere (kommen später nochmal) Eine Feuerhexe. Ich bin ein großer Fan von Elementarmagie, geprägt auch durch mein Fable für das Kampagnensetting Al-Qadim für AD&D2. Die Verbundenheit Damatus mit elementaren Urwelten und der Einfluss von "Elementarmeistern" machen das auf Damatu auch möglich.. Ein zwergischer Ordenskrieger. Ein höherer Offizier der Ordenskrieger von Casdasar. Eine Kriegerin aus einer magie- und technologieärmeren Region Midgards. In meinem Kopf ist das Azarlar. Ein Zwergenpriester aus dem Grenzgebiet zu Myrskogu Eine eflische Ordenskriegerin aus Casdasar. Ein Arenakämpfer aus Urdarat. Er war ein Krieger der Panzerkavallerie, bis er sich ganz dem Kampf in der Arena gewidmet hat.

-

Teaser Video für meine Midgard - Legenden von Damatu Runde

Danke für das nette Feedback. Das freut mich, wenn es noch jemandem gefällt. 😁 Tatsächlich habe ich mir die Freiheit herausgenommen, nahezu jeglichen Midgard 5 Kanon bei der Erstellung der Szenen einmal über Bord zu werfen. Ich bin nur meinem inneren Bild aus den bisherigen Beschreibungen von Damatu gefolgt und habe versucht, das in mit einer passenden Musik in Bewegung zu setzen. Darum ist es wohl auch eher schwierig, Kreaturen einem in Midgard 5 abgebildeten Gegenstück zuzuordnen (falls du das meintest). Und zu Damatu habe ich vor allem die Eindrücke aus den ersten Abenteuern gezogen und dann mit meinem persönlichen Geschmack vermengt. Ich gebe zu, das macht das Arbeiten an so einem Video deutlich entspannter, als bei meinen DSA Clips, bei den so mancher steil gegangen ist, wenn der Orc nicht so und so aussah 😅.

-

Teaser Video für meine Midgard - Legenden von Damatu Runde

Für meine anstehende Legenden von Damatu Runde habe ich einen kurzen Teaser erstellt, um die SpielerInnen auf die neue Welt einzustimmen. Ich gebe zu, bei manchen Szenen habe ich etwas frei gedreht, aber ich war gerade in der Stimmung 😅. Trigger Warnung: Ausufernder Einsatz von KI https://youtu.be/147gnFDaVeE?is=M_H3QhujB8dUYLhi